Feature Subset Selection

Die Feature Subset Selection (FSS), kurz Feature Selection oder Merkmalsauswahl, ist ein Ansatz aus dem maschinellen Lernen, bei dem nur eine Teilmenge der verfügbaren Features für maschinelles Lernen verwendet wird. FSS ist notwendig, weil es teilweise technisch unmöglich ist, alle Features mit einzubeziehen oder weil es Differenzierungsprobleme gibt, wenn eine große Anzahl an Features, aber nur eine kleine Zahl an Datensätzen vorhanden ist oder um Überanpassung des Modells zu vermeiden, siehe Verzerrung-Varianz-Dilemma.

Ansätze

[Bearbeiten | Quelltext bearbeiten]Es gibt drei Hauptansätze zur Feature Selection.

Filter-Ansatz

[Bearbeiten | Quelltext bearbeiten]

Berechne ein Maß zur Unterscheidung von Klassen. Messe das Gewicht der Features und wähle die besten n aus. Auf dieses Feature Subset wird der Lernalgorithmus angewendet. Filter können entweder univariat (z. B. euklidische Distanz, Chi-Quadrat-Test) oder multivariat (z. B. Korrelationsbasierte Filter) die intrinsischen Eigenschaften der Daten berechnen. Feature selection durch Filtern ist ein spezieller Fall des Strukturlernens, welches z. B. im Kontext von Bayesschem Lernen häufig Anwendung findet.

Vorteile:

- schnell berechenbar

- skalierbar

- intuitiv interpretierbar

Nachteile:

- Redundante Features (Verwandte Features werden ähnliche Gewichtung haben)

- ignoriert Abhängigkeiten mit dem Lernalgorithmus

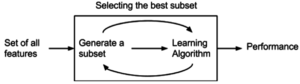

Wrapper-Ansatz

[Bearbeiten | Quelltext bearbeiten]

Durchsuche die Menge aller möglichen Feature-Subsets. Auf jedes Subset wird der Lernalgorithmus angewendet. Das Durchsuchen kann entweder deterministisch oder randomisiert erfolgen: Deterministische Algorithmen sind z. B.:

- Forward selection

- Recursive feature elimination[1]

Randomisierte Algorithmen sind z. B.:

- simulated annealing

- genetische Algorithmen

Vorteile:

- Findet ein Feature-Subset, das optimal zum Lernalgorithmus passt

- Bezieht auch Kombinationen von Features ein und nicht nur jedes Feature einzeln

- Entfernt redundante Features

- einfach umzusetzen

- interagiert mit Lernalgorithmus

Nachteile:

- Sehr zeitaufwändig

- bei heuristischen Verfahren besteht die Gefahr nur lokale Optima zu finden

- Gefahr der Überanpassung der Daten, daher gibt es Warnungen zur Verwendung von forward oder backward feature selection[2]

- Abhängigkeit vom Lernalgorithmus

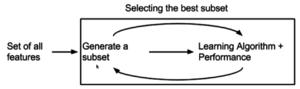

Embedded-Ansatz

[Bearbeiten | Quelltext bearbeiten]

Die Suche nach einer optimalen Untermenge ist direkt mit dem Lernalgorithmus verbunden.

Vorteile:

- bessere Laufzeiten und geringere Komplexität

- Abhängigkeiten zwischen Datenpunkten werden modelliert

Nachteile:

- Wahl der Untermenge hängt stark vom verwendeten Lernalgorithmus ab.

Beispiele:

- Lasso-Regression

- Elastic Net Regularisierung

- Entscheidungsbäume

- Gewichtete Naive Bayes-Klassifikator[3]

- Auswahl der Teilmenge mit Hilfe des Wichtungsvektor von SVM[4]

Beispiele für Algorithmen

[Bearbeiten | Quelltext bearbeiten]Correlation Feature Selection

[Bearbeiten | Quelltext bearbeiten]Gute Untermengen von Features enthalten Features, welche stark mit der Zielvariablen korreliert sind, aber dennoch möglichst unkorreliert untereinander sind.[5] Correlation Feature Selection (CFS) wählt als Filter-Algorithmus die Untermengen mit vielen Features wie folgt aus:

wobei die Korrelationskoeffizienten (z. B. Spearman-Korrelation oder Pearson-Korrelation) zwischen Zielvariable und Feature sind und die Korrelationskoeffizienten der Features und untereinander.

Boruta

[Bearbeiten | Quelltext bearbeiten]Boruta[6] ist ein Algorithmus zur Feature Selection, welcher zunächst weitere zufällige Features einführt und die Feature Importance jedes Features mit der dieser zufälligen Features vergleicht: Features, welche häufig unwichtiger als diese zufälligen Features waren, werden verworfen.

Relief-Algorithmus

[Bearbeiten | Quelltext bearbeiten]Relief basierte Algorithmen folgen der Filtermethodik und analysieren Unterschiede der Features bei nächsten Nachbarn, welche andern Klassen angehören.

Regularisierung

[Bearbeiten | Quelltext bearbeiten]Regularisierung mit dem L1-Loss wählt gewisse Features aus, siehe Lasso-Regression. Es ist ein Beispiel für den Embedded-Ansatz. Bei der Lasso-Regression (und orthogonalen Merkmalen) kann mithilfe von Subdifferentialen[7] die Soft-Threshold-Funktion hergeleitet werden, welche einige Parameter der Kleinste-Quadrate-Regression (OLS) direkt auf Null setzt:

Feature Selection mit Annealing

[Bearbeiten | Quelltext bearbeiten]Feature Selection mit Annealing erlaubt Feature Selection mit gewissen statistischen Garantien[8].

Siehe auch

[Bearbeiten | Quelltext bearbeiten]Literatur

[Bearbeiten | Quelltext bearbeiten]- Dunja Mladenić: Feature Selection for Dimensionality Reduction. Craig Saunders et al. (Hrsg.): SLSFS, 2005, S. 84–102, ISBN 3-540-34137-4

- Yvan Saeys, Inaki Inza and Pedro Larranaga (2007) A review of feature selection techniques in bioinformatics. Bioinformatics. 23(19) 2507--2517.

Einzelnachweise

[Bearbeiten | Quelltext bearbeiten]- ↑ https://scikit-learn.org/stable/modules/feature_selection.html

- ↑ Flom, Lynda & Cassell, David. (2007). Stopping stepwise: Why stepwise and similar selection methods are bad, and what you should use. NorthEast SAS Users Group Inc 20th Annual Conference: 11-14th November 2007; Baltimore, Maryland.

- ↑ Duda,P. et al. (2001) Pattern Classification. Wiley, New York.

- ↑ Guyon,I. and Elisseeff,A. (2003) An introduction to variable and feature selection. J. Mach Learn Res., 3, 1157–1182.

- ↑ Baris Senliol, Gokhan Gulgezen, Lei Yu, Zehra Cataltepe: Fast Correlation Based Filter (FCBF) with a different search strategy. In: 2008 23rd International Symposium on Computer and Information Sciences. 2008, S. 1–4, doi:10.1109/ISCIS.2008.4717949 (englisch).

- ↑ Boruta - A System for Feature Selection January 2010 Fundamenta Informaticae 101(4):271-285 doi:10.3233/FI-2010-288

- ↑ https://xavierbourretsicotte.github.io/lasso_derivation.html

- ↑ Feature Selection with Annealing for Computer Vision and Big Data Learning Adrian Barbu, Yiyuan She, Liangjing Ding, Gary Gramajo doi:10.1109/TPAMI.2016.2544315

![{\displaystyle \mathrm {CFS} =\max _{S_{k}}\left[{\frac {r_{cf_{1}}+r_{cf_{2}}+\cdots +r_{cf_{k}}}{\sqrt {k+2(r_{f_{1}f_{2}}+\cdots +r_{f_{i}f_{j}}+\cdots +r_{f_{k}f_{k-1}})}}}\right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/576479b39143e5307d93ac04305c86383011fe94)