p-Hacking

p-Hacking, auch als specification searching bekannt, bezeichnet die Verzerrung[1] und Manipulation von Forschungsresultaten, deren Ziel es ist, den p-Wert (d. h. die statistische Signifikanz) durch nachträgliche Anpassung der Testparameter unter eine bestimmte Grenze zu reduzieren.

Der p-Wert wird „gehackt“, also künstlich unter die 5 %-Grenze gedrückt. Auf diese Weise wird eine vermeintliche statistische Signifikanz der Ergebnisse erzeugt. Die häufige Fehlinterpretation von p-Werten sowie die Anwendung von p-Hacking haben zu unzähligen falschen Forschungsergebnissen geführt, die der Wissenschaft geschadet haben.[2] p-Hacking kann als Reaktion wissenschaftlicher Autoren auf die Tatsache angesehen werden, dass Studien mit signifikanten Ergebnissen für die Publikation präferiert werden und Analysen, die nichtsignifikante Resultate aufweisen, unveröffentlicht bleiben (File-Drawer-Problem). Mithilfe von Metaanalysen ist es möglich, -Hacking aufzudecken.[1]

Statistische Signifikanz durch Zufall

[Bearbeiten | Quelltext bearbeiten]Beim Prozess des Data-Minings in einem einzigen Datensatz werden durch automatisiertes Suchen von Variablenkombinationen, die eine Korrelation aufweisen könnten, eine große Anzahl an Hypothesen getestet. Dieses Vorgehen kann jedoch das Problem der Alphafehler-Kumulierung mit sich bringen: Konventionelle Signifikanztests legen a priori eine Fehlerwahrscheinlichkeit (größer als Null) für einen Fehler 1. Art fest. Es muss also das Risiko akzeptiert werden, mit der Wahrscheinlichkeit ein falsch positives Testergebnis zu erhalten (d. h. ein positives Ergebnis, obwohl tatsächlich die Nullhypothese gilt). Wenn eine Vielzahl von statistischen Tests (wie beispielsweise bei genomweiten Assoziationsstudien) durchgeführt wird, dann produzieren einige der Tests per Konstruktion durch Zufall falsch positive (scheinbar signifikante) Ergebnisse[3]. Somit stellt sich heraus, dass 5 % der zufällig ausgewählten Hypothesen nur durch Zufall signifikant auf dem 5 %-Level sind, 1 % auf dem 1 %-Level usw. Wenn ausreichend viele Hypothesen getestet wurden, ist es praktisch sicher, dass manche Hypothesen fälschlicherweise als statistisch signifikant erscheinen.

Beispiel: Schokoladendiät

[Bearbeiten | Quelltext bearbeiten]In einer satirisch angelegten Studie[4] behauptete John Bohannon 2015, dass Bitterschokolade als Teil einer Diät zu Gewichtsreduktion führen könne.

Um diese Behauptung mit einer Irrtumswahrscheinlichkeit kleiner als 5 % zu veröffentlichen (also ), dachte er sich im Vorfeld 18 unterschiedliche Kriterien aus, auf die Bitterschokolade eine Wirkung haben könnte, beispielsweise Gewicht, Cholesterol-Wert, Blutdruck, Schlafqualität etc. Einzeln für sich war es sehr unwahrscheinlich, dass Bitterschokolade eines dieser Kriterien statistisch signifikant beeinflusst. Aber dadurch, dass es so viele Kriterien waren, war von Anfang an die Wahrscheinlichkeit hoch, dass irgendeine von ihnen (zufälligerweise) signifikant mit dem Konsum von Bitterschokolade korrelieren würde. In dieser Studie ergab sich, dass die Behauptung mit der Gewichtsreduktion „statistisch signifikant“ war.

Die Studie wies absichtlich zahlreiche andere methodische Fehler auf und wollte dadurch auf genau diese Missstände hinweisen.

Weitere Praktiken

[Bearbeiten | Quelltext bearbeiten]Eine Variante des p-Hackings liegt vor, wenn während einer Studie die statistische Relevanz der Daten geprüft wird, um vom Ergebnis dieser Prüfung abhängig zu machen, ob weitere zusätzliche Daten erhoben werden. Desgleichen, wenn die Erhebung von Daten nach einer solchen Zwischenprüfung vorzeitig beendet wird. Stattdessen sollte vorab festgelegt werden, welche Datenmenge untersucht wird. Auch das nachträgliche Ausschließen, Kombinieren oder Aufteilen von Beobachtungsgruppen weist auf versuchtes -Hacking hin.

Wenn zur Messung eines Effektes Störfaktoren herausgerechnet werden müssen, die Auswahl der zu berücksichtigenden Störfaktoren aber von der sich jeweils ergebenden Größe des gemessenen Effekts abhängig gemacht wird, ist dies ebenfalls p-Hacking. Eine weitere Variante ist das Abrunden eines p-Wertes, der die vorgegebene Schwelle in nicht angegebenen Nachkommastellen überschreitet.

Gegenmaßnahmen

[Bearbeiten | Quelltext bearbeiten]Untersuchungen können alternativ mit dem Kreuzvalidierungsverfahren und einem separaten Validierungsdatensatz oder der Bonferroni-Korrektur durchgeführt werden, um das Problem des p-Hacking zu verringern.

In einigen Fachzeitschriften geht man mittlerweile zum Format des registrierten Berichts über (in dem nicht wie bisher nur positive Befunde berichtet werden können, sondern auch negative Befunde). Ziel ist es, Publikationsbias wie p-Hacking und HARKing entgegenzutreten.[5]

Power-Analysen sollten verwendet werden, um Tests mit der nötigen Power zu designen, damit die Stichprobengröße nicht im Nachhinein so lange angepasst wird, bis ein signifikantes Ergebnis erhalten wird (was p-Hacking wäre).

Literatur

[Bearbeiten | Quelltext bearbeiten]- John P. A. Ioannidis: Why Most Published Research Findings Are False. In: PLOS Medicine. 2. Jahrgang, Nr. 8. Public Library of Science, San Francisco 30. August 2005, S. e124, doi:10.1371/journal.pmed.0020124, PMID 16060722, PMC 1182327 (freier Volltext) – (englisch).

- Megan L. Head, Luke Holman, Rob Lanfear, Andrew T. Kahn, Michael D. Jennions: The Extent and Consequences of P-Hacking in Science. In: PLOS Biology. 13. Jahrgang, Nr. 3, 13. März 2015, S. e1002106, doi:10.1371/journal.pbio.1002106, PMID 25768323, PMC 4359000 (freier Volltext) – (englisch).

Weblinks

[Bearbeiten | Quelltext bearbeiten]- Martin Sewell: Data Snooping. Data snooping occurs when a set of data is used more than once for purposes of inference or model selection. A bibliography on data-snooping bias. 21. Januar 2013, abgerufen am 28. September 2024.

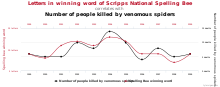

- Tyler Vigen: Spurious Correlations. 28. Januar 2022, abgerufen am 28. September 2024 (englisch).

- Regina Nuzzo: Wenn Forscher durch den Signifikanztest fallen. In: Spektrum.de. 13. März 2017, abgerufen am 28. September 2024. Kritik am p-Wert.

Einzelnachweise

[Bearbeiten | Quelltext bearbeiten]- ↑ a b Megan L. Head u. a.: The Extent and Consequences of P-Hacking in Science. In: PLOS Biology. 13. März 2015, doi:10.1371/journal.pbio.1002106. S. 1.

- ↑ Regina Nuzzo: Wenn Forscher durch den Signifikanztest fallen. In: Spektrum.de. 2. Februar 2014, abgerufen am 28. September 2024.

- ↑ Thomas B. Dodson: The Problem With P-Hacking. In: Journal of Oral and Maxillofacial Surgery. Band 77, Nr. 3, März 2019, ISSN 0278-2391, S. 459–460, doi:10.1016/j.joms.2018.12.034.

- ↑ John Bohannon: I Fooled Millions Into Thinking Chocolate Helps Weight Loss. Here’s How. 27. Mai 2015, abgerufen am 28. September 2024 (amerikanisches Englisch).

- ↑ Promoting reproducibility with registered reports. In: Nature.com. 10. Januar 2017, doi:10.1038/s41562-016-0034.