Benutzer:Heinrich Puschmann/Pivotverfahren (Kladde)

<-- Geordnete Liste der Belege:

[1] [2] [3] [4] [5] [6] [7] [8] [9] [10] [11]

Pivotverfahren (auch Basisaustauschverfahren) sind Algorithmen der mathematischen Optimierung. Für ein vorgegebenes System linearer Gleichungen in nichtnegativen Variablen wird nach der bestmöglichen von vielen Alternativlösungen (einer sogenannten Optimallösung) gesucht, und auf dieser Suche das Gleichungssystem Schritt für Schritt umgewandelt ohne dabei die Lösungsmenge zu verändern. Wichtige Pivotverfahren sind die Simplexverfahren und die Criss-Cross-Verfahren.

Pivotverfahren spielen für die Behandlung von linearen Ungleichungen eine analoge und ähnlich wichtige Rolle wie das Gaußsche Eliminationsverfahren für die Lösung linearer Gleichungen; Hauptanwendungsgebiet ist die lineare Optimierung. Sie gehören zu den meistverwendeten Lösungsmethoden in der Unternehmensforschung, der Wirtschaftswissenschaft, dem Gütertransport, und sie werden auch in vielen anderen Gebieten wie im Ingenieurbau (Strukturoptimierung), in der Statistik (Regressionsanalyse) und der Spieltheorie zunehmend eingesetzt[4]. Aufgaben mit zehntausenden Variablen und Ungleichungen sind an der Tagesordnung[5].

Pivotverfahren, oder pivotbasierter Optimierungsalgorithmus kann sich jeder Algorithmus nennen, der für seine Suche nach einem Optimum ein lineares Gleichungssystem aufstellt und in jedem Schritt strategisch ausgewählte Variablen bezüglich der Restvariablen freilegt, wobei sich aufeinanderfolgend freigelegte Variablensätze in nur einer Variable unterscheiden. Wichtige Pivotverfahren sind die Simplex-Verfahren [3][4] und die Criss-Cross-Verfahren [6] in der linearen Optimierung.

Pivotansatz

[Bearbeiten | Quelltext bearbeiten]Allgemeine Vorgehensweise

[Bearbeiten | Quelltext bearbeiten]Ein Pivotverfahren geht immer von einem besonders gearteten linearen Gleichungssystem aus, in dem alle Variablen, außer vielleicht einer, nichtnegative Werte annehmen sollen. Jedes System linearer Ungleichungen oder Gleichungen, und auch jede lineare Optimierungsaufgabe, lässt sich nämlich in folgende (englisch dictionary genannte [3]) Buchform bringen:

wobei reelle (in der Praxis freilich immer rationale) Zahlen sind. Diese Darstellung soll aussagen, dass eine Lösung in den Unbekannten gesucht wird, welche die obigen Gleichungen beziehungsweise Ungleichungen erfüllt und dabei die sogenannte Zielvariable so groß wie möglich wählt. Mit Hilfe der Indexmengen

- und

lässt sich diese Aufgabe auch wie folgt in gedrungener Form ausdrücken:

In jedem Schritt eines Pivotverfahrens ist wie oben eine Teilmenge der Variablen als unabhängig hervorgehoben, während die restlichen Variablen, sogenannte Basisvariablen, als lineare Funktionen der unabhängigen Variablen ausgedrückt werden; in aufeinanderfolgenden Schritten wechselt immer eine der Variablen von unabhängig auf Basisvariable und eine zweite in die umgekehrte Richtung; solche Variablenpaare werden Pivots genannt.

Falls nun beide folgende Optimumbedingungen erfüllt sind, nämlich

- für alle (Zulässigkeit) und

- für alle (Zielbeschränkung),

dann kann man eine Lösung für die obige Aufgabe erhalten, indem man die unabhängigen Variablen auf die Werte setzt. Zum einen sind die Werte der freigelegten Variablen dann nichtnegativ, wie gefordert. Zum anderen dürfen sonstige mögliche Lösungen nur unabhängige Variable mit ebenfalls nichtnegativen Werten enthalten, so dass für jede dieser Lösungen die Ungleichung gilt.

Im folgenden Beispielsystem,

werden die Optimumbedingungen aber an zwei Stellen verletzt, da und ist. Zum ersten würde die Versuchslösung den negativen Wert enthalten, und zum zweiten könnte dessen Zielvariablenwert bei Lösungen mit unter Umständen erhöht werden.

Falls die Optimumbedingungen nicht erfüllt sind, was in der Regel der Fall sein wird,

lässt sich das obige lineare Gleichungssystem aber auch andersartig ausdrücken,

indem man an Stelle von

eine andere, gleich große Teilmenge der Unbekannten auswählt und diese freilegt.

Es sei eine Umstellung der Unbekannten also eine Indexfunktion die

erfüllt. Für neue Indexmengen

- und

erstellen wir dann das Gleichungssystem:

Dabei ist zu beachten, dass Einträge wie nur für Indexpaare mit und definiert sind. Die Einträge des so abgewandelten Gleichungssytems lassen sich nun erneut auf die Optimumbedingungen überprüfen,

- für alle (Zulässigkeit) und

- für alle (Zielbeschränkung),

was wiederum unter Umständen zu einer Lösung der Aufgabe führt.

Die Menge wird Menge der Basisvariablen oder einfach Basis genannt. Ein Standardergebnis der Linearen Optimierung sagt aus, dass für jede lösbare Aufgabe ein Satz Basisvariablen existiert, der zu einer Lösung führt. Bei erfüllten Optimumbedingungen bilden die Basisvariablen eine sogenannte Optimalbasis des Systems.

Jedes nichtverschwindende des obigen Gleichungssystems, dem Pivotsystem,

nennt sich Pivotelement,

und erlaubt es, die unabhängige Variable an Stelle der Basisvariablen freizulegen, um so weiter nach einer Lösung zu suchen.

Das ist die Vorgehensweise eines allgemeinen Pivotverfahrens,

wobei aber nicht irgendwelche Pivotelemente gewählt werden, sondern nur

sogenannte zulässige Pivots , die folgendes erfüllen müssen:

- entweder gilt gleichzeitig und (Zulässigkeitspivot),

- oder es gilt gleichzeitig und (Zielfortschrittspivot).

Im obigen Beispielsystem

sind wegen der Optimalitätsverletzung Pivotelement mit Pivot und Pivotelement mit Pivot zulässig. Wegen der Optimalitätsverletzung sind aber ebenfalls Pivotelement mit Pivot , und Pivotelement mit Pivot zulässig.

Die Beschränkung auf zulässige Pivots verhindert, dass derselbe Pivot zweimal hintereinander ausgewählt wird. Die Regeln, nach denen in jedem Schritt eines dieser zulässigen Pivotelemente ausgewählt wird, hängen vom jeweiligen Verfahren ab; ein Mindestanspruch ist dabei natürlich, dass das Verfahren nach endlich vielen Schritten anhält, was bei ungeeigneter Auswahl von zulässigen Pivots nicht der Fall ist. Fukuda & Terlaky haben 1999 bewiesen, dass für jede lösbare Aufgabe und für jede Ausgangsbasis eine Folge von maximal zulässigen Pivots existiert, die zu einer Optimalbasis führt [7]. Leider liefert ihr Beweis keine Vorgehensweise, um diese Pivots in jedem Optimierungsschritt auch zu finden.

Wie aus der Definition zu ersehen ist, haben Optimalbasen keine zulässigen Pivots, das Verfahren kann in so einem Fall gar nicht fortgeführt werden. Anderseits kann anhand von Argumenten wie im obigen Abschnitt leicht gezeigt werden, dass eine nichtoptimale Basis ohne zulässige Pivots immer zu einer Aufgabe gehört, die keine Lösung hat; entweder, weil das System der Gleichungen und Ungleichungen überhaupt keine Lösung hat (unzulässige Aufgabe), oder, weil sich Lösungen mit beliebig großem finden lassen (unbeschränkte Aufgabe).

Eine erfolgssichere Pivotauswahlregel

[Bearbeiten | Quelltext bearbeiten]Wir wählen vorerst ein Beispiel ohne Zielvariable, das heißt, mit . In so einem Fall wird keine der Variablen maximiert; es werden nur beliebige (nicht negative) Werte für die Unbekannten gesucht, die ein vorgegebenes Gleichungssystem erfüllen. In jedem Schritt wollen wir dann den zulässigen Pivot nach folgender Regel wählen:

- Wähle ,

- Danach wähle .

Diese (nicht besonders effiziente) Auswahlregel fällt wegen mit der Kleinster-Index-Pivotauswahl zusammen; es lässt sich beweisen [6], dass diese Auswahl bei jeder lösbaren Aufgabe zu einer Optimalbasis führt.

Wir suchen nun Werte für die Unbekannten , die folgendes Gleichungssystem erfüllen:

Die zulässigen Pivots im obigen Gleichungssystem sind und ;

wir legen an Stelle von frei:

Das neue System ist

Die zulässigen Pivots sind nun und ;

jetzt legen wir an Stelle von frei:

Wir erhalten das System

Der einzige zulässige Pivot hier ist ;

wir legen deshalb an Stelle von frei:

Nun erhalten wir

Da dieses System die Optimalitätsbedingungen erfüllt (und dem entsprechend auch keine zulässigen Pivots hat), erhalten wir die Lösung:

Eine kreislaufanfällige Pivotauswahlregel

[Bearbeiten | Quelltext bearbeiten]Die Reihenfolge, in welcher Variable und Gleichungen eines Pivotsystems aufgelistet werden ist grundsätzlich willkürlich. Dennoch wurden die ersten Pivotauswahl-Strategien, welche Variablen und Gleichungen unabhängig von deren Darstellung im Pivotsystem behandeln (und dazu noch leicht umsetzbar waren), erst 1977 von Bland [2] vorgestellt. In der Anfangszeit der Pivotverfahren (1950-1970), als noch nicht streng zwischen Algorithmen und Datenstrukturen unterschieden wurde, wurden Pivotauswahl-Strategien eher anhand von Datenstrukturen (sogenannte "Tableaus") beschrieben, und bei dieser Art Strategien konnte die Endlichkeit des Verfahrens ohne Zusatzberechnungen meist nicht gewährleistet werden. Es folgt ein Beispiel einer solchen ungeeigneten Pivotauswahl.

Es sei wieder .

Bei ungeeigneter Pivotwahl kann ein Pivotverfahren in einen unendlichen Kreislauf oder Endlosschleife geraten.

Als Beispiel für eine naheliegende, aber dennoch ungeeignete, Pivotwahl betrachten wir folgende Regel,

die dem weitverwendeten dualen Simplexverfahren nachempfunden ist:

- Wähle das kleinste mit ,

- Danach wähle das kleinste mit .

Wir starten mit dem System:

Wir wählen und legen an Stelle dessen frei (nach der kreissicheren Regel im vorherigen Beispiel hätten wir und gewählt). Wir erhalten das System:

Wir wählen , legen an Stelle dessen frei, und erhalten:

Aber dieses Gleichungssystem ist -abgesehen von der Benennung der Veränderlichen- identisch mit dem Startsystem. Die Zahleneinträge des Systems wiederholen sich alle 2 Schritte, nach 6 Schritten wiederholen sich die Gleichungen des Systems in umgestellter Form, und nach insgesamt 12 Schritten wiederholt sich das Startsystem genau, mit den Gleichungen und Unbekannten am ursprünglichen Ort. Das Gesamtsystem von Gleichungen und Ungleichungen hat in Wirklichkeit gar keine Lösung, doch kann das Pivotverfahren mit der oberen Pivotwahl das nicht herausfinden.

Dualität

[Bearbeiten | Quelltext bearbeiten]Duale Optimierungsaufgaben

[Bearbeiten | Quelltext bearbeiten]Jeder linearen Optimierungsaufgabe lässt sich, von der obigen Grundform abhängig, eine zweite, duale Optimierungsaufgabe zuordnen; die Koeffizientenmatrix dieser sogenannten dualen Aufgabe ist die negative Transposition der Koeffizientenmatrix der ursprünglichen Aufgabe:

In gedrungener Form wird das zu

(Vorsicht: Bei der Herleitung über diese Formulierung dürfen nicht durch ersetzt werden!)

Offenbar führt die duale Umwandlung einer dualen Aufgabe wieder zur ursprünglichen Aufgabe; das ist aber nur dann leicht ersichtlich, wenn die Aufgabe in die hier verwendete Form gebracht wurde.

Schrittweise Umwandlung

[Bearbeiten | Quelltext bearbeiten]Die obige Beziehung der Koeffizienten zwischen Primalaufgabe und Dualaufgabe gilt nicht etwa nur für die Ausgangsbasis, sondern bleibt erhalten, solange die Basisvariablen nach denselben Pivots umgewandelt werden. Es gilt

Diese Dualitätsbeziehung lässt sich am leichtesten an einem Pivotsystem betrachten,

das ausschließlich zwei unabhängige Unbekannte und zwei freigelegte Unbekannte enthält.

Wir erhalten dasselbe System, wenn wir zuerst zwei der Unbekannten austauschen und danach die duale Aufgabe herleiten,

oder wenn wir diese Schritte in umgekehrter Reihenfolge tun:

|

| |||

|

|

Dieses Schema zeigt auch an, wie sich die Einträge des Pivotsystems von einem Schritt auf den nächsten verändern. Das Zeichen steht für den gemeinsamen Nenner des Gleichungssystems, das Zeichen für den Zähler des Pivotelements, für einen sonstigen Eintrag der Pivotzeile, für einen sonstigen Eintrag der Pivotspalte, und für einen beliebigen Eintrag abseits von Pivotzeile und Pivotspalte. Einträge der Zielbeitragszeile () und der Basiswertspalte () werden nach denselben Regeln umgewandelt.

Beispiel zur Dualität

[Bearbeiten | Quelltext bearbeiten]Die Aufgabe im obigen Beispiel hat folgende duale Aufgabe (die Nullen stammen von ):

Bei der ursprünglichen Aufgabe hatten wir an Stelle von freigelegt. Wenn wir im dualen Gleichungssystem an Stelle von freilegen, erhalten wir:

Wenn wir nun an Stelle von freilegen, erhalten wir:

Wenn wir an Stelle von freilegen, erhalten wir:

Der größtmögliche Wert für die Zielvariable ist somit . Das ist derselbe Wert, den auch schon die Anfangslösung hatte, doch war das aus dem ersten Gleichungssystem nicht ersichtlich und ist selbstverständlich nicht immer der Fall.

Criss-Cross-Verfahren

[Bearbeiten | Quelltext bearbeiten]Criss-Cross-Verfahren[6] (englisch: kreuz und quer) sind kombinatorische Pivotverfahren, das heißt Pivotverfahren, welche nur die Vorzeichen der Systemkoeffizienten und nicht die Koeffizienten selber für die Pivotauswahl in Betracht ziehen. Ihren Ursprung hatten Criss-Cross-Verfahren bei der Untersuchung orientierter Matroiden.

Aufgabenbereich und Forschungsziele

[Bearbeiten | Quelltext bearbeiten]Die einfachsten aller Pivotverfahren gehören zu den Criss-Cross-Verfahren[6], welche in den 80er-Jahren für Aufgabestellungen von orientierten Matroiden[12] entwickelt wurden. Die wesentlich komplexeren Simplexverfahren[3][4] wurden aber bereits 1947 von George Dantzig für die Lösung linearer Optimierungsprobleme veröffentlicht und haben danach dank ihrer weiten Verbreitung die Suche nach Criss-Cross-Verfahren maßgeblich motiviert. Weitere Pivotverfahren wurden entwickelt für das lineare Komplementaritätsproblem mit suffizienten[16] Matrizen (einschließlich quadratischer[14] Programmierung) und für linear-fraktionale[15] Optimierungsprobleme.

Bei der Ausarbeitung verschiedener Pivotverfahren geht es in der Hauptsache darum, die Anzahl der Pivotschritte und damit auch die Laufzeit des Verfahrens gering zu halten. Während Laufzeitschranken für allgemeine Pivotverfahren, und insbesondere für Criss-Cross-Verfahren, ein noch (2010) offenes Forschungsthema[8] sind, beanspruchen die derzeit schon länger bekannten Simplexverfahren alle eine überpolynomial beschränkte Laufzeit, das ist eine Laufzeit, die sich nicht durch ein Polynom in der Datenspeichergröße beschränken lässt. Zusammenfassend lässt sich sagen, dass Criss-Cross-Verfahren mehr Freiheitsgrade aufweisen als Simplexverfahren, und dass ein Criss-Cross-Verfahren genau aus diesem Grund bei einer guten Pivotauswahl schneller[7] und bei einer schlechten Pivotauswahl langsamer[9] als Simplexverfahren sein kann.

Besondere Criss-Cross-Verfahren

[Bearbeiten | Quelltext bearbeiten]Das Kleinster-Index-Pivotverfahren ist das bekannteste aller Criss-Cross-Verfahren und erweitert die Kleinster-Index Pivotauswahl [6] aus dem ersten Beispiel. Dafür werden die Unbekannten in einer mehr oder weniger festen Reihenfolge angeordnet und die Pivots wie folgt ausgewählt (wie üblich, sei das Minimum einer leeren Menge unendlich groß):

- Suche die Indices und .

- Falls , ist, wähle Pivot mit .

- Falls , ist, wähle Pivot mit .

Das lässt natürlich die Frage offen, wie die Variablen angeordnet werden sollen.

Das Häufigster-Index-Pivotverfahren (englisch most frequent index) wählt als seine beiden Pivotvariablen immer diejenige zulässige Variable, welche bis zu diesem Schritt am öftesten für einen Pivot ausgewählt wurde (bei gleicher Prio darf beliebig ausgewählt werden).

Das Criss-Cross-Verfahren mit Stackauswahl (englisch Last-In_First-Out, LIFO) wählt als seine beiden Pivotvariablen immer diejenige zulässige Variable, welche als letzte für einen Pivot ausgewählt wurde (gleiche Prio kann hier nicht vorkommen).

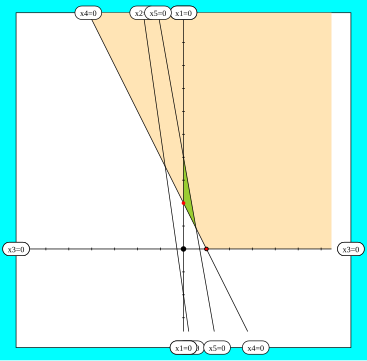

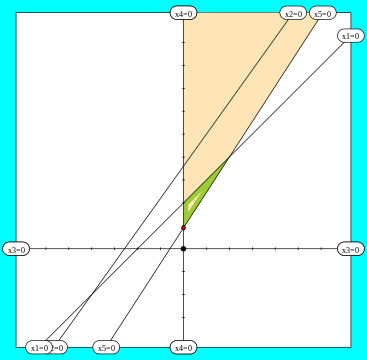

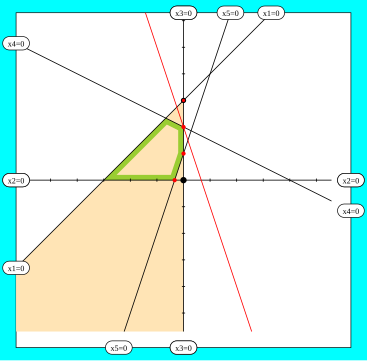

Beispiel zu einem Criss-Cross-Verfahren

[Bearbeiten | Quelltext bearbeiten]Im folgenden Beispiel sollen Werte für die Variablen gefunden werden, welche das Gleichungssystem

erfüllen und dabei die zusätzliche Zielvariable auf ein Maximum bringen. Wir benutzen dazu die oben angeführte Pivotauswahl des kleinsten Index.

In unserem Ausgangssystem sind sämtliche Pivots zulässig; die Auswahlregel schreibt aber vor, dass wir freilegen und gegen austauschen:

Das führt zum neuen System

Hier sind die Pivots , und , zulässig; anhand der Auswahlregel legen wir an Stelle von frei:

Wir erhalten das System

Die zulässigen Pivots dieses Gleichungssystems sind und ; wir legen an Stelle von frei:

Nun erhalten wir

Dieses Gleichungssystem ist optimal, die entsprechenden Werte der Unbekannten sind:

Simplex-Verfahren

[Bearbeiten | Quelltext bearbeiten]Simplexverfahren[3][4] waren die ersten Pivotverfahren für die Lineare Optimierung, und wurden 1947 von George Dantzig veröffentlicht und seitdem vielfach weiterentwickelt. Die Suche nach einer Pivotauswahl, welche sowohl durchschnittlich schnell und in Extremfällen auch sicher zum Ziel kommen soll, führte zu immer komplexeren Auswahlregeln, die in der Praxis nicht immer streng eingehalten werden, und wegen unvermeidlicher Rundungsfehler meist nicht streng eingehalten werden können.

Primale Simplexverfahren

[Bearbeiten | Quelltext bearbeiten]Primale Simplexverfahren gehen von einer sogenannten zulässigen Basis mit für alle aus, und untersuchen ausschließlich zulässige Basen, bis eine Optimalbasis gefunden wird. Eine wichtige Eigenschaft der primalen Simplexverfahren ist, dass der Wert der Zielvariablen, also , mit jedem Schritt monoton anwächst; würde er streng monoton anwachsen, wäre die Endlichkeit des Verfahrens gesichert. Ein primales Simplexverfahren muss seine Pivots wie folgt wählen:

- Wähle ein beliebiges , welches erfüllt. Zum Beispiel (Bland [2]), suche das kleinste mit dieser Eigenschaft.

- Wähle ein beliebiges , welches und erfüllt. Zum Beispiel (Bland), suche das kleinste mit dieser Eigenschaft.

Um eine zulässige Ausgangsbasis zu erhalten, muss in einer sogenannten 1. Phase eine Hilfsaufgabe gelöst werden.

Ein Standardergebnis der Linearen Optimierung besagt, dass für jede lösbare Aufgabe und für jede zulässige Basis eine Folge zulässiger Pivots existiert, die über ausschließlich zulässige Basen zu einer Optimalbasis führt; unbekannt ist dagegen, ob es eine Folge dieser Art gibt, deren Länge sich polynomial in der Speichergröße der Daten beschränken lässt.

Duale Simplexverfahren

[Bearbeiten | Quelltext bearbeiten]Duale Simplexverfahren sind Pivotverfahren, die von einer sogenannten dual-zulässigen Basis mit für alle ausgehen, und in ihrer Suche nach einer Optimalbasis ausschließlich dual-zulässige Basen untersuchen; der Wert der Zielvariablen nimmt dabei monoton ab. Duale Simplexverfahren erzeugen die gleichen Pivotfolgen wie die auf die duale Aufgabe angewandten primalen Simplexverfahren, und haben deshalb auch grundsätzlich die gleichen Eigenschaften wie die primalen Verfahren. Dass sie für die Lösung vieler angewandter Aufgaben trotzdem den Primalverfahren vorgezogen werden, liegt daran, dass es für viele angewandte Aufgaben leichter ist, eine dual-zulässige Ausgangsbasis zu finden.

Symmetrische Simplexverfahren

[Bearbeiten | Quelltext bearbeiten]Symmetrische oder primal-duale Simplexverfahren suchen eine zulässige Lösung für das aus primalen und dualem System bestehendes Aufgabenpaar. Um beide Aufgaben auch effizient zu behandeln wird aber nur eine Datentabelle verwendet und die wechselseitige Beziehung dualer Aufgaben ausgenützt. Bei symmetrischen Simplexverfahren entfällt die Aufteilung in Phase 1 und Phase 2.

Weiterführende Hinweise

[Bearbeiten | Quelltext bearbeiten]Literatur

[Bearbeiten | Quelltext bearbeiten]Obwohl viele Texte der linearen Optimierung auf dem Markt zu finden sind, erreichen wenige die übersichtliche Klarheit und den zugänglichen Lesestil der Bücher von Chvátal[3] und von Vanderbei[4]. Beide wurden vielfach empfohlen[10][11] und das letztere in der Auflage von 2007 aktualisiert. Das Geschichtswerk vom Begründer der linearen Optimierung, George Dantzig[1], liefert dazu viele lesenswerte Einzelheiten, ist aber für eine Einführung in das Thema weniger geeignet.

Interaktives Applet

[Bearbeiten | Quelltext bearbeiten]Robert Vanderbei's interaktives Pivotverfahren-Applet von 1997 erlaubt dem Benutzer, ein lineares Gleichungssystem mit freigelegten Basisvariablen aufzustellen und anschließend beliebige Variablen dieses Gleichungssystems umzustellen. Obwohl sich das Applet «Simplex Pivot Tool» nennt, ist es auf ganz allgemeine Pivotverfahren ausgerichtet. Die Koeffizienten können auch rundungsfrei als Bruchzahlen eingesehen werden, werden aber nicht auf einen gemeinsamen Nenner gebracht.

Einzelnachweise

[Bearbeiten | Quelltext bearbeiten]- ↑ a b George Dantzig (1963): Lineare Programmierung und Erweiterungen., Springer-Verlag, 1963/1966, (Originalausgabe: Linear Programming and Extensions, Princeton University Press, ISBN 0-691-05913-6, pdf-Datei)

- ↑ a b c Robert Bland (1977): New finite pivoting rules for the simplex method, Mathematics of Operations Research, vol.2, 103-107, pdf-Datei

- ↑ a b c d e f Vašek Chvátal (1983): Linear Programming., Freeman and Company, ISBN 0-7167-1587-2

- ↑ a b c d e f Robert Vanderbei (1996/2007): Linear Programming; Foundations and Extensions, 3.ed. Springer (2007), ISBN 978-0-387-74387-5, pdf-Datei, (Alternativausgabe: Linear Programming; Foundations and Extensions, Kluwer, ISBN 978-0-7923-9804-2)

- ↑ a b Robert Vanderbei (1996): Linear Programming; Foundations and Extensions, 3.ed. Springer (2007), ISBN 978-0-387-74387-5, Kap.21.4: "Simplex Method vs Interior-Point Methods"

- ↑ a b c d e f Komei Fukuda & Tamás Terlaky (1997): Criss-cross methods: A fresh view on pivot algorithms, Mathematical Programming, 79, 369-395, ps-Datei

- ↑ a b c Komei Fukuda & Tamás Terlaky (1999): On the Existence of a Short Admissible Pivot Sequences for Feasibility and Linear Optimization Problems, Pure Mathematics and Applications, vol.10, 431-447, ps-Datei

- ↑ a b Shuzhong Zhang (1999): New variants of finite criss-cross pivot algorithms for linear programming, European Journal of Operations Research, vol.116(3), 607-614, pdf-Datei

- ↑ a b Komei Fukuda & Bohdan Kaluzny (2004): The criss-cross method can take Ω(n^d) pivots, Symposium on Computational Geometry 2004, 401-408, ps-Datei

- ↑ a b Leserbewertung von Chvatal's "Linear Programming"

- ↑ a b Leserbewertung von Vanderbei's "Linear Programming"

- ↑ a b Oriented matroid

- ↑ Sufficient Matrices

- ↑ a b Quadratic Programming

- ↑ a b Linear Fractional Programming

- ↑ Referenzfehler: Ungültiges

<ref>-Tag; kein Text angegeben für Einzelnachweis mit dem Namen sufficient matrix.

![{\displaystyle {\begin{matrix}z&=&f&+&~~~~~d_{1}\,x_{1}&+&\cdots &+&~~~~~d_{n}\,x_{n}\\[3pt]x_{n+1}&=&b_{n+1}&+&G_{n+1,1}\,x_{1}&+&\cdots &+&G_{n+1,n}\,x_{n}\\\vdots &&\vdots &&\vdots &&&&\vdots \\x_{n+m}&=&b_{n+m}&+&G_{n+m,1}\,x_{1}&+&\cdots &+&G_{n+m,n}\,x_{n}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f09bbf72db1fcfbcd303a394cd2b9d896d89c800)

![{\displaystyle {\begin{matrix}&&z&=&f&+&\sum _{j\in D}\,d_{j}\,x_{j}\\[6pt]\forall ~i\in B&&x_{i}&=&b_{i}&+&\sum _{j\in D}\,G_{i,j}\,x_{j}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/794d9b6a3388e029e919524b86bb0475a800bf25)

![{\displaystyle {\begin{matrix}z&=&~~~0&-~3x_{1}&+~~\mathbf {x_{2}} \\[2pt]x_{3}&=&~~~3&-~~x_{1}&-~~x_{2}\\[2pt]x_{4}&=&~~~8&+~2x_{1}&-~4x_{2}\\[2pt]x_{5}&=&-~\mathbf {1} &+~3x_{1}&+~~x_{2}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/4a6804f416ea87c5027afe2e37e92db7b4cda050)

![{\displaystyle {\begin{matrix}&&z&=&f^{B}&+&\sum _{j\in D(\pi )}\,d_{j}^{B}\,x_{j}\\[6pt]\forall ~i\in B(\pi )&&x_{i}&=&b_{i}^{B}&+&\sum _{j\in D(\pi )}\,G_{i,j}^{B}\,x_{j}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e85361373a91d415999469a771088029f50938db)

![{\displaystyle {\begin{matrix}z&=&~~~0&-~3x_{1}&+~~~\mathbf {x_{2}} \\[2pt]x_{3}&=&~~~3&-~~x_{1}&-~~~{\underline {\mathbf {x_{2}} }}\\[2pt]x_{4}&=&~~~8&+~2x_{1}&-~{\underline {\mathbf {4x_{2}} }}\\[2pt]x_{5}&=&-~\mathbf {1} &+~{\underline {\mathbf {3x_{1}} }}&+~~~{\underline {\mathbf {x_{2}} }}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9e1656f33b903b2101d21e10cbc64f8b3aa9a178)

![{\displaystyle {\begin{matrix}x_{3}&=&(&-~\mathbf {2} &-~7x_{1}&+~{\underline {\mathbf {2x_{2}} }}&)~/~1\\[2pt]x_{4}&=&(&-~4&-~5x_{1}&+~2x_{2}&)~/~1\\[2pt]x_{5}&=&(&~~~9&+~2x_{1}&-~3x_{2}&)~/~1\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d756f762e61c4a8d485295c611df8c1dfdc1d13c)

![{\displaystyle {\begin{matrix}x_{2}&=&(&~~~2&+~~7x_{1}&+~~~~x_{3}&)~/~2\\[2pt]x_{4}&=&(&-~\mathbf {4} &+~~{\underline {\mathbf {4x_{1}} }}&+~~~2x_{3}&)~/~2\\[2pt]x_{5}&=&(&~~12&-~17x_{1}&-~~~3x_{3}&)~/~2\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b989c48f52ce7c22d6a52b0687d34abed75ecd75)

![{\displaystyle {\begin{matrix}x_{2}&=&(&~~18&+~~7x_{4}&-~~5x_{3}&)~/~4\\[2pt]x_{1}&=&(&~~~4&+~~2x_{4}&-~~2x_{3}&)~/~4\\[2pt]x_{5}&=&(&-\mathbf {10} &-~17x_{4}&+~{\underline {\mathbf {11x_{3}} }}&)~/~4\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/3a751d58c9c09942b25037b36dba943c0ed6a049)

![{\displaystyle {\begin{matrix}x_{2}&=&(&~~37&-~~2x_{4}&-~~~5x_{5}&)~/~11\\[2pt]x_{1}&=&(&~~~6&-~~3x_{4}&-~~~2x_{5}&)~/~11\\[2pt]x_{3}&=&(&~~10&+~17x_{4}&+~~~4x_{5}&)~/~11\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5659c33c9714cce76035a79f2832736b8dc06fb3)

![{\displaystyle {\begin{matrix}x_{3}&=&(&-~3&-~3x_{1}&+~~x_{2}&)~/~1\\[2pt]x_{4}&=&(&-~\mathbf {4} &-~7x_{1}&+~{\underline {\mathbf {2x_{2}} }}&)~/~1\\[2pt]x_{5}&=&(&~~~2&+~2x_{1}&-~~x_{2}&)~/~1\\[2pt]x_{6}&=&(&~~~9&+~7x_{1}&-~3x_{2}&)~/~1\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5643e6dd3b1b714eedd98bd85690db7b200973af)

![{\displaystyle {\begin{matrix}x_{3}&=&(&-~\mathbf {2} &+~~{\underline {\mathbf {x_{1}} }}&+~~x_{4}&)~/~2\\[2pt]x_{2}&=&(&~~~4&+~7x_{1}&+~~x_{4}&)~/~2\\[2pt]x_{5}&=&(&~~~0&-~3x_{1}&-~~x_{4}&)~/~2\\[2pt]x_{6}&=&(&~~~6&-~7x_{1}&-~3x_{4}&)~/~2\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5e27a43a3e411da293d3c04c6be7e293a30b83db)

![{\displaystyle {\begin{matrix}x_{1}&=&(&~~~2&+~2x_{3}&-~~x_{4}&)~/~1\\[2pt]x_{2}&=&(&~~~9&+~7x_{3}&-~3x_{4}&)~/~1\\[2pt]x_{5}&=&(&-~3&-~3x_{3}&+~~x_{4}&)~/~1\\[2pt]x_{6}&=&(&-~\mathbf {4} &-~7x_{3}&+~{\underline {\mathbf {2x_{4}} }}&)~/~1\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/929f2666121b773fa162617ad856b720e1926b7d)

![{\displaystyle {\begin{matrix}w&=&-\;f&-&b_{1}\,y_{n+1}&-&\cdots &-&b_{m}\,y_{n+m}\\[3pt]y_{1}&=&-\;d_{1}&-&G_{n+1,1}\,y_{n+1}&-&\cdots &-&G_{n+m,1}\,y_{n+m}\\\vdots &&\vdots &&\vdots &&&&\vdots \\y_{n}&=&-\;d_{n}&-&G_{n+1,n}\,y_{n+1}&-&\cdots &-&G_{n+m,n}\,y_{n+m}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b69740dc2bd698664779fec772dc9aed203779e8)

![{\displaystyle {\begin{matrix}&&w&=&(-f)&+&\sum _{i\in B}\,(-b_{i})\,y_{i}\\[6pt]\forall ~j\in D&&y_{j}&=&(-d_{j})&+&\sum _{i\in B}\,(-G_{i,j})\,y_{i}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/97cfb41d976d5ca7639dc59afeacdb2b9f21e7a3)

![{\displaystyle {\begin{matrix}&&w&=&(-f^{B})&+&\sum _{i\in B(\pi )}\,(-b_{i}^{B})\,y_{i}\\[6pt]\forall ~j\in D(\pi )&&y_{j}&=&(-d_{j}^{B})&+&\sum _{i\in B(\pi )}\,(-G_{i,j}^{B})\,y_{i}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6ff49f8b0b99e2c8f6a4e6d7da2cae909858ba19)

![{\displaystyle {\begin{matrix}\delta \,x_{i}&\!=\!&(~~\alpha )&\!\!\!x_{j}&\!+\!&(~~\sigma )&\!\!\!x_{s}\\[6pt]\delta \,x_{r}&\!=\!&(~~\zeta )&\!\!\!x_{j}&\!+\!&(~~p)&\!\!\!x_{s}\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6d0c16c9d414104fbef3eece921fac518843e3e8)

![{\displaystyle {\begin{matrix}p\,x_{i}&\!=\!&({\frac {\alpha p\,-\,\zeta \sigma }{\delta }})&\!\!\!x_{j}&\!+\!\!&(~\sigma )&\!\!\!x_{r}\\[6pt]p\,x_{s}&\!=\!&(~-\zeta ~)&\!\!\!x_{j}&\!+\!\!&(~\delta )&\!\!\!x_{r}\\\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/506f471524a8143dba84c50421a73925aa34ed4e)

![{\displaystyle -\,[\cdots ]^{\,T}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/2331baecd2351bac704e20ba3665c9d89f7cf742)

![{\displaystyle {\begin{matrix}\delta \,y_{j}&\!=\!&(-\alpha )&\!\!\!y_{i}&\!+\!&(-\zeta )&\!\!\!y_{r}\\[6pt]\delta \,y_{s}&\!=\!&(-\sigma )&\!\!\!y_{i}&\!+\!&(-p)&\!\!\!y_{r}\\\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ca3a749640a8ec5915c25e4f9ce875b77e426708)

![{\displaystyle {\begin{matrix}p\,y_{j}&\!=\!&({\frac {\zeta \sigma \,-\,\alpha p}{\delta }})&\!\!\!y_{i}&\!+\!\!&(~~\zeta )&\!\!\!y_{s}\\[6pt]p\,y_{r}&\!=\!&(~-\sigma ~)&\!\!\!y_{i}&\!+\!\!&(-\delta )&\!\!\!y_{s}\\\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c192f8fb16b5eab0eceb4c069880a0196f21f370)

![{\displaystyle {\begin{matrix}~w~&=&(&0&+~~\mathbf {2y_{3}} &+~~4y_{4}&-~~9y_{5}&)~/~1\\[2pt]y_{1}&=&(&0&+~~7y_{3}&+~~5y_{4}&-~~2y_{5}&)~/~1\\[2pt]y_{2}&=&(&0&-~~{\underline {\mathbf {2y_{3}} }}&-~~2y_{4}&+~~3y_{5}&)~/~1\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/76d445237a02e2a1cebac28a43948d7e2366e9c2)

![{\displaystyle {\begin{matrix}~w~&=&(&0&-~~2y_{2}&+~~\mathbf {4y_{4}} &-~12y_{5}&)~/~2\\[2pt]y_{1}&=&(&0&-~~7y_{2}&-~~{\underline {\mathbf {4y_{4}} }}&+~17y_{5}&)~/~2\\[2pt]y_{3}&=&(&0&-~~~y_{2}&-~~2y_{4}&+~~3y_{5}&)~/~2\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b70c6116cb741456a272904a4b8ee64c3d4c0fa6)

![{\displaystyle {\begin{matrix}~w~&=&(&0&-~18y_{2}&-~~4y_{1}&+~\mathbf {10y_{5}} &)~/~4\\[2pt]y_{4}&=&(&0&-~~7y_{2}&-~~2y_{1}&+~17y_{5}&)~/~4\\[2pt]y_{3}&=&(&0&+~~5y_{2}&+~~2y_{1}&-~{\underline {\mathbf {11y_{5}} }}&)~/~4\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/338edf5a5029ec1bde2304decb43694fcccc86de)

![{\displaystyle {\begin{matrix}~w~&=&(&0&-~37y_{2}&-~~6y_{1}&-~10y_{3}&)~/~11\\[2pt]y_{4}&=&(&0&+~~2y_{2}&+~~3y_{1}&-~17y_{3}&)~/~11\\[2pt]y_{5}&=&(&0&+~~5y_{2}&+~~2y_{1}&-~~4y_{3}&)~/~11\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a6d31ca0cbfa88fec9ad8c5ab0dae7f7b7fbedb9)

![{\displaystyle {\begin{matrix}z&=&(&~~~0&+~\mathbf {3x_{1}} &+~2x_{2}&)~/~1\\[2pt]x_{3}&=&(&~~~3&-~{\underline {\mathbf {2x_{1}} }}&-~~x_{2}&)~/~1\\[2pt]x_{4}&=&(&~~~7&-~2x_{1}&-~3x_{2}&)~/~1\\[2pt]x_{5}&=&(&~~~4&-~3x_{1}&-~~x_{2}&)~/~1\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9bcc63ee2d5f4d8bb3003f632c6dbe3ea4541810)

![{\displaystyle {\begin{matrix}z&=&(&~~~9&-~3x_{3}&+~~\mathbf {x_{2}} &)~/~2\\[2pt]x_{1}&=&(&~~~3&-~~x_{3}&-~~{\underline {\mathbf {x_{2}} }}&)~/~2\\[2pt]x_{4}&=&(&~~~8&+~2x_{3}&-~4x_{2}&)~/~2\\[2pt]x_{5}&=&(&-~1&+~3x_{3}&+~~x_{2}&)~/~2\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7a285d35f38bfe29a9baca8d5b20cec6888440d5)

![{\displaystyle {\begin{matrix}z&=&(&~~~6&-~2x_{3}&-~~x_{1}&)~/~1\\[2pt]x_{2}&=&(&~~~3&-~~x_{3}&-~2x_{1}&)~/~1\\[2pt]x_{4}&=&(&-~\mathbf {2} &+~3x_{3}&+~{\underline {\mathbf {4x_{1}} }}&)~/~1\\[2pt]x_{5}&=&(&~~~1&+~~x_{3}&-~~x_{1}&)~/~1\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5dff1b909d574f9103748c18887d53444e59bf8a)

![{\displaystyle {\begin{matrix}z&=&(&~~22&-~5x_{3}&-~~x_{4}&)~/~4\\[2pt]x_{2}&=&(&~~~8&+~2x_{3}&-~2x_{4}&)~/~4\\[2pt]x_{1}&=&(&~~~2&-~3x_{3}&+~~x_{4}&)~/~4\\[2pt]x_{5}&=&(&~~~2&+~7x_{3}&-~~x_{4}&)~/~4\end{matrix}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b7b5b1771b7e0080cfc88f743adb231e1b5a51d6)